大模型爆显存救星?谷歌TurboQuant解析与3-bit压缩实战探索

随着大语言模型(LLMs)的参数规模突破千亿甚至万亿级别,训练和推理过程中的显存消耗已成为AI开发者面临的核心瓶颈。传统的16-bit(FP16/BF16)或8-bit(INT8)量化技术虽然有效,但在追求极致边缘部署和成本控制的场景下,压缩极限仍有待突破。谷歌提出的“TurboQuant”技术及其相关的3-bit超低精度量化方案,因其在保持模型性能的大幅降低存储与计算开销的潜力,被视为应对“显存危机”的新一代“救星”。本文旨在解析TurboQuant的核心思想,并探讨其在数据处理与存储支持服务中的实战价值。

一、 谷歌TurboQuant技术解析:不止于量化

TurboQuant并非一个单一的量化算法,而是一个系统性的量化优化框架。其核心目标是在极低比特位宽(如3-bit、4-bit)下,最大限度地保留大模型的性能。传统低比特量化面临两大挑战:1) 精度损失导致的模型能力(尤其是推理和泛化能力)急剧下降;2) 现有硬件对非常规比特位(如3-bit)的算术运算支持有限。

TurboQuant通过多管齐下的方式应对这些挑战:

- 精细化分组量化(Group-wise Quantization):不同于对整个张量使用统一的量化参数,TurboQuant将权重矩阵划分为更小的组(如每128个权重为一组),为每组独立计算缩放因子(scale)和零点(zero point)。这能更好地捕捉权重分布的内部差异,减少量化误差。

- 混合精度策略:框架识别出模型中对精度敏感的关键层或组件(如注意力机制中的某些投影层),对其保持较高比特位(如8-bit),而对其他大部分权重实施超低比特量化。这种“好钢用在刀刃上”的策略,在压缩率和精度之间取得了更优平衡。

- 高级校准与后训练优化:利用更具代表性的校准数据集,并结合知识蒸馏或轻微的梯度微调(一种轻量化的训练后量化方法),让量化后的模型适应低精度表示,从而恢复部分因量化损失的性能。

- 算法-硬件协同设计考量:虽然3-bit运算在通用GPU上并非原生支持,但TurboQuant的设计考虑了未来专用AI加速器的趋势。通过结构化的稀疏性和特定位宽格式,为高效的内核实现铺平道路,理论上可大幅提升能效比。

二、 3-bit压缩实战:数据处理与存储的范式革新

将TurboQuant理念应用于3-bit压缩实战,对数据处理和存储支持服务提出了新的要求,也带来了革命性的机遇。

1. 数据处理流程的重构

- 量化感知数据准备:用于校准和微调的数据集需要精心挑选,确保其能充分代表模型在实际任务中的数据分布。数据处理管道需要集成校准数据采样、统计量(如最小值、最大值)计算等功能模块。

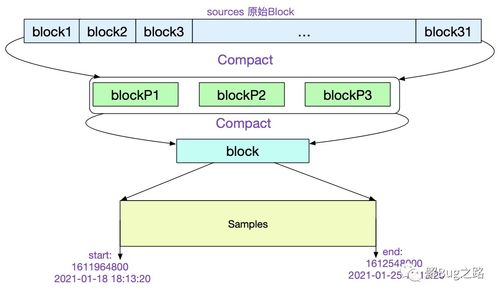

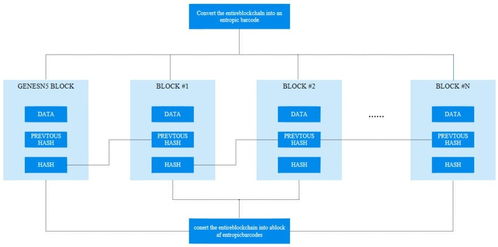

- 动态量化参数管理:在服务端,由于采用分组量化,每个模型不仅需要存储3-bit的权重本身,还需要存储额外的量化参数(每组对应的scale和zero point)。虽然这些参数总量很小,但数据管理系统需要设计高效的格式来封装和索引这些元数据。

- 多版本模型管理:同一模型可能同时存在FP16、INT8、INT4和INT3等多个量化版本,以服务不同延迟、成本要求的场景。数据平台需支持灵活的模型版本管理、A/B测试和灰度发布。

2. 存储支持服务的巨变与优化

- 存储成本大幅降低:这是最直接的收益。一个175B参数的模型,FP16格式需要约350GB存储,而3-bit量化后可降至约66GB,仅为原来的19%。这对于需要归档大量模型版本、或提供模型市场服务的企业来说,能节省海量云存储开销。

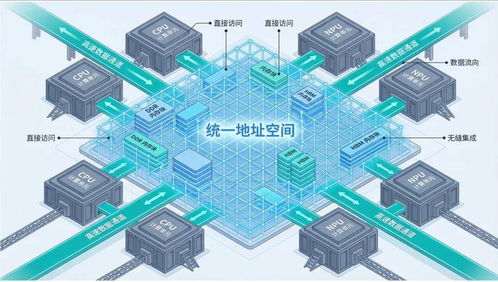

- 内存与显存占用的革命性减少:推理时,模型权重可常驻于更便宜、容量更大的系统内存甚至SSD中,仅通过高效的I/O和缓存机制按需加载到显存。这使在消费级显卡(如仅具12GB显存)上运行超大规模模型成为可能,极大降低了推理硬件门槛。

- 模型分发与加载加速:模型文件体积的减小,意味着从中央仓库到边缘节点的网络传输时间显著缩短,模型冷启动加载速度更快,提升了服务的敏捷性和用户体验。

- 专用存储格式与引擎:为了高效处理3-bit权重,可能需要设计新的二进制存储格式(如将多个3-bit整数打包到一个32位字中),并开发相应的压缩/解压缩库,以在加载时快速还原为硬件友好的计算格式。

三、 挑战与未来展望

尽管前景光明,TurboQuant与3-bit量化的全面落地仍面临挑战:

- 硬件支持:目前主流GPU(NVIDIA)对3-bit运算的硬件加速支持有限,主要依靠软件模拟,可能无法立即实现理论上的速度提升。其性能优势需待下一代AI芯片(如Google TPU、定制化ASIC)的生态成熟。

- 精度-效率的终极权衡:对于某些复杂任务(如代码生成、复杂推理),3-bit量化可能仍会导致难以接受的性能下降,需要更先进的算法进行补偿。

- 工具链成熟度:完整的、用户友好的3-bit量化工具链(集成到PyTorch、TensorFlow等主流框架)仍需时间发展和完善。

展望未来,TurboQuant所代表的超低比特量化技术,正与模型架构创新(如MoE)、编译器优化等技术共同推动大模型走向“平民化”。对于云计算厂商和AI服务提供商而言,投资于支持高效超低比特模型的数据处理与存储服务体系,将是在下一轮AI基础设施竞争中构建核心优势的关键。它不仅关乎成本,更关乎能否为更广泛的开发者和企业提供触手可及的巨型AI能力。3-bit压缩,或许正是打开这扇大门的一把重要钥匙。

如若转载,请注明出处:http://www.hlkaldksa.com/product/16.html

更新时间:2026-05-22 20:31:38